Mehr Tempo, weniger Abhängigkeit

Wie souveräne KI und KI-Governance die wehrhafte Demokratie stärken

Verwaltung der Zukunft: Können Sie der Leserschaft kurz darstellen, worüber Ihr Best Practice Dialog gehandelt hat?

Bracht: Unsere Demokratie steht in diesen Zeiten sowohl von innen als auch von außen unter erheblichem Druck. Der technologische Fortschritt – insbesondere im Bereich der generativen Künstlichen Intelligenz (KI) – eröffnet neue Möglichkeiten, um komplexe Herausforderungen wie den Fachkräftemangel zu adressieren. Gleichzeitig erfordert der verantwortungsvolle Einsatz von KI eine klare Regulierung, wertebasierte Governance und Datensouveränität, um Missbrauch zu verhindern und demokratische Grundwerte zu schützen.

Dieser Best-Practice-Dialog hat konkrete Ansätze und Fallbeispiele beleuchtet, wie KI genutzt werden kann, um die Effizienz und Resilienz demokratischer Systeme zu stärken. Dabei haben wir diskutiert, wie souveräne KI entwickelt und eingesetzt werden kann, ohne gesellschaftliche Akzeptanz zu gefährden, und wie Governance-Strukturen gestaltet werden müssen, um die Zukunftsfähigkeit Deutschlands und seiner demokratischen Ordnung nachhaltig zu sichern.

VdZ: Sie beginnen Ihre Präsentation mit einer klaren Diagnose: geopolitische Konflikte, Fachkräftemangel, Bürokratiekrise. Welche Rolle spielt KI ganz konkret, um diese Herausforderungen im öffentlichen Sektor zu bewältigen?

Dr. Precht: Deutschland braucht Effizienz in der öffentlichen Verwaltung, denn Vertrauen entsteht dort, wo demokratische Prinzipien auf wirksames Regierungshandeln treffen. Souveräne Künstliche Intelligenz (KI) kann dabei eine Schlüsselrolle spielen. Richtig eingesetzt macht sie staatliches Handeln effizienter, transparenter und widerstandsfähiger, vorausgesetzt ihre Einführung erfolgt nachvollziehbar, kontrollierbar und mit dem Ziel, menschliche Intelligenz zu ergänzen, nicht zu ersetzen. Studien und Praxisprojekte zeigen bereits das große Potenzial von KI im öffentlichen Sektor. Bürgeranfragen lassen sich automatisch analysieren, Bescheide schneller erstellen, neue Mitarbeitende effizient einarbeiten. Dabei bescheinigen Studien dem KI-Einsatz nicht nur Zeitersparnis mit über 25 Prozent schnelleren Bearbeitungszeiten und 12 Prozent höherer Produktivität, sondern auch eine um 40 Prozent gesteigerte Qualität erledigter Aufgaben (z.B. Dell'Acqua et al., 2023). Ein Beispiel ist das Jugendamt im Landratsamt Augsburg. Die Mitarbeitenden müssen rechtssichere Bescheide zu Jugendhilfeleistungen innerhalb enger Fristen erstellen. Die KI-Anwendung „JuKi“ unterstützt bei dieser Aufgabe. Sie analysiert Belege und Rechtsprechung und liefert nachvollziehbare Empfehlungen. Mitarbeitende können diese prüfen, anpassen und offene Fragen mit einem integrierten Assistenten klären. Die Entscheidungsgewalt bleibt beim Menschen, die Bearbeitungszeit verkürzt sich massiv. Ohne KI dauert das Sammeln der Fallinformationen bis zu einer Stunde. Mit KI sind es fünf Minuten, bei gleichzeitig höherer Genauigkeit.

VdZ: Sie zeigen eindrückliche Praxisbeispiele, von Sozialhilfe über Gerichte bis zum Verteidigungsministerium. Was war aus Ihrer Sicht der „Gamechanger“, der diese Projekte erfolgreich gemacht hat?

Bracht: Drei entscheidende Faktoren tragen aus unserer Sicht wesentlich zu erfolgreichen Projekten bei. Erstens war es entscheidend, sich auf konkrete, werthaltige Use Cases zu konzentrieren. Indem wir uns auf spezifische Anwendungsfälle fokussierten, konnten wir einzelne Mitarbeitende von lästigen, zeitraubenden Tätigkeiten entlasten. Diese Fokussierung ermöglichte es uns, den Gewinn des Einsatzes von KI direkt mess- und erfahrbar zu machen und direkt zum Alltag der Mitarbeitenden beizutragen. Ein Beispiel hierfür ist die Automatisierung von Routineaufgaben, die es den Mitarbeitenden ermöglicht, sich auf komplexere und wertschöpfendere Aufgaben zu konzentrieren.

Zweitens war die frühzeitige Einbindung der zukünftigen Nutzerinnen und Nutzer in den Entwurfsprozess von zentraler Bedeutung. Durch ihre Beteiligung konnten wir sicherstellen, dass die entwickelten Lösungen praxisrelevant und benutzerfreundlich sind. Dieser Ansatz half uns, die tatsächlichen Bedürfnisse der Anwender zu verstehen und Lösungen zu entwickeln, die genau auf diese Bedürfnisse zugeschnitten sind.

Drittens haben wir uns konsequent an das Vorgehensmodell 'Ethics by Design' gehalten. Dieser Ansatz stellt sicher, dass ethische Überlegungen von Beginn an in den Entwicklungsprozess integriert werden. Durch die Berücksichtigung ethischer Aspekte konnten wir Lösungen entwickeln, die nicht nur effizient, sondern auch transparent sind und damit verantwortungsbewusst eingesetzt werden können. Dies war insbesondere in sensiblen Bereichen wie Sozialhilfe, Justiz und Verteidigung von großer Bedeutung.

Insgesamt zeigt sich, dass die Kombination aus einem klaren Fokus auf werthaltige Use Cases, der frühzeitigen Einbindung der Nutzer und einer ethischen Gestaltung des Entwicklungsprozesses der Schlüssel zum Erfolg dieser Projekte war. Diese Faktoren haben es uns ermöglicht, Lösungen zu entwickeln, die einen echten Mehrwert für die Anwender bieten und gleichzeitig ethischen Standards gerecht werden.

VdZ: IBM spricht über „agentic AI“, also KI, die eigenständig handelt. Wie lässt sich das mit dem Bedürfnis nach Kontrolle und Nachvollziehbarkeit im Staat vereinbaren?

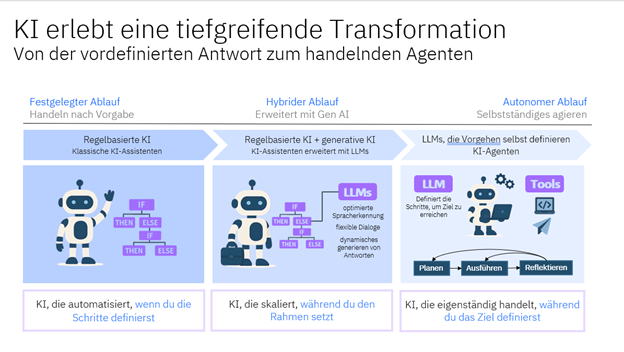

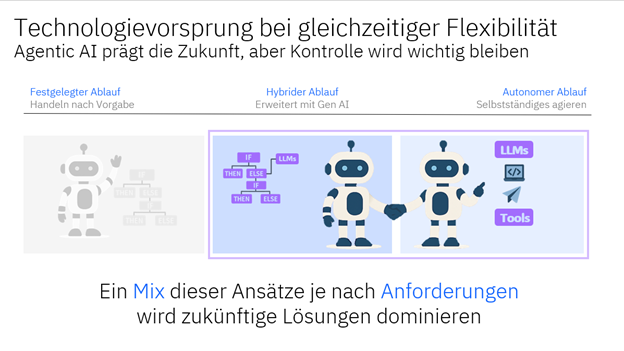

Dr. Precht: In den letzten Jahren hat KI eine tiefgreifende Transformation durchlaufen – von starren, vordefinierten Abläufen hin zu hochflexiblen, autonomen KI-Agenten. Regelbasierte KI, wie klassische KI-Assistenten, automatisiert Aufgaben dann, wenn die einzelnen Schritte dafür zuvor definiert wurden. Das bietet maximale Kontrolle, erfordert aber auch einen hohen Aufwand. Hybride Ansätze, die regelbasierte KI mit generativer KI kombinieren – etwa KI-Assistenten, die Large Language Models (LLMs) nutzen – ermöglichen eine bessere Skalierbarkeit. Ich gebe hier den Rahmen vor, kann aber gleichzeitig die Vorteile generativer KI nutzen. Solche Systeme profitieren von optimierter Spracherkennung, flexiblen Dialogen und können Inhalte wie Antworten oder E-Mails dynamisch generieren. KI-Agenten gehen noch einen Schritt weiter: Sie nutzen LLMs, um selbst zu entscheiden, wie sie ein Ziel erreichen. Ich definiere das Ziel, die KI-Agenten planen und führen die Aufgaben eigenständig aus.

Wichtig ist: KI-Agenten unterscheiden sich von hybriden Lösungen – die regelbasierte und generative KI kombinieren – nicht unbedingt in den Ergebnissen, wohl aber grundlegend in ihrem Vorgehen. Das autonome Handeln von KI-Agenten kann bekannte Risiken generativer KI daher verstärken.

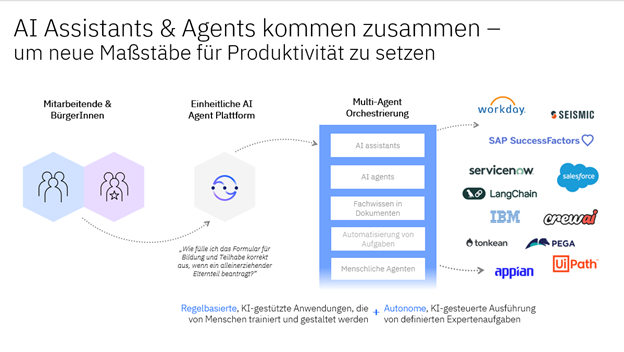

Deshalb ermöglicht es IBM, regelbasierte und autonome KI intelligent in KI-Lösungen zu kombinieren, um von den Stärken beider Ansätze zu profitieren. KI-Agenten sind hierbei ein echter Game Changer. Als Nutzer:in stellen Sie einfach eine Frage - der KI-Agent orchestriert im Hintergrund und kann aus regelbasierten, hybriden oder autonomen Lösungen auswählen, je nachdem, was für die Beantwortung der Frage am besten geeignet ist.

So behalten Sie maximale Kontrolle wo notwendig, und profitieren gleichzeitig von den Vorteilen autonomer KI-Agenten. Generative KI setzen wir dabei grundsätzlich in Verbindung mit unserer Governance-Lösung watsonx.governance ein. Diese ermöglicht es, die Qualität aller eingesetzten KI-Lösungen durch Echtzeitanalysen zu überwachen und Transparenz zu gewährleisten.

VdZ: Mit der zunehmenden Nutzung generativer KI wächst auch das Risiko, beispielsweise mit Halluzinationen, mangelnden Quellen, Bias. Wie geht IBM konkret mit diesen Risiken um?

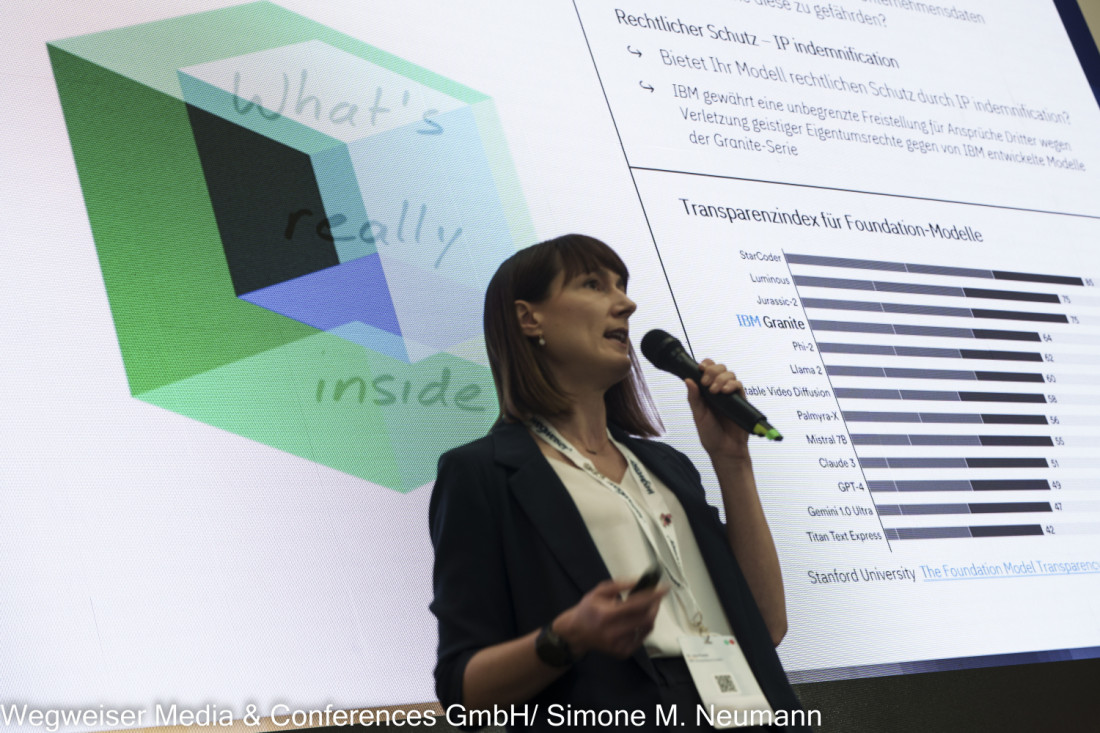

Bracht: Zunächst einmal hilft eine systematische, ingenieurmäßige Auseinandersetzung mit all diesen genannten Risiken. Einige Risiken wie zum Beispiel Bias, also Verzerrungen in Daten, die ein Modell im Training dann mehr oder weniger auswendig lernt, sind nicht neu, sondern schon aus dem Bereich traditioneller KI wohlbekannt. Weitere Risiken wie beispielsweise ungenügende Erklärbarkeit gab es auch früher schon; sie sind allerdings im Bereich generativer KI zweifelsohne verstärkt und noch schwieriger zu bewältigen. Und wiederum andere Risiken wie z. B. Halluzinationen, also letztendlich das Erfinden unwirklicher Sachverhalte, sind tatsächlich neu und erst bei der Generierung neuer Inhalte durch KI entstanden. Der öffentlich verfügbare IBM AI Risk Atlas ordnet all diese Risikobereiche in die Klassen “schon bekannt”, “verstärkt” und “neu” ein und ermöglicht eine sorgfältige Risikoauseinandersetzung und -mitigierung.

In unserem schon zuvor angesprochenen “Ethics by Design”-Vorgehensmodell ist es nun entscheidend, diese Risiken und daraus resultierende ethische Belange nicht erst hinterher zu adressieren, wenn eine Lösung schon fertig konzipiert ist. Man sollte auch nicht schon vorher allzu bedenkenträgerisch eine Beschäftigung mit der Ausgestaltung von Lösungen überhaupt verhindern. Vielmehr hilft es, sich eben während des Entwurfsprozesses bewusst auf ethische Fragestellungen zu stoßen: Was könnte hier schieflaufen? Habe ich wirklich eine ausgewogene Datenmenge beisammen, oder wird eine bestimmte Personengruppe möglicherweise diskriminiert? Erkennen die Nutzerinnen und Nutzer, dass sie es mit KI zu tun haben, und wissen, wie eine Ausgabe zustande gekommen ist? Daraus lassen sich dann passende Konsequenzen ableiten — technischer Natur wie zum Beispiel durch Messungen und “Herausrechnen” von Verzerrungen oder den Einsatz erklärender Verfahren, oder prozessualer Natur wie zum Beispiel durch spezielle Schulungsprogramme. Bei der Arbeit mit ersten Skizzen und Demonstratoren werden Risikoaspekte üblicherweise am besten erlebbar und können dann passgenau angegangen werden. Letztendlich geht es darum, dass alle Beteiligten gut mit den möglicherweise noch verhandenen, auf die gerade beschriebene Art und Weise reduzierten minimalen Restrisiken leben können, damit der Vorteil des KI-Einsatzes deutlich überwiegt.

VdZ: Was ist Ihrer Meinung nach die größte Fehleinschätzung beim EU AI Act, die Behörden aktuell noch haben und wie begegnet man ihr strategisch richtig?

Bracht: Eine große Fehleinschätzung, die ich allgemein im Zusammenhang mit dem EU AI Act beobachte, ist die Neigung, auf die konkrete nationale Ausgestaltung der zunächst einmal europäischen Gesetzgebung zu warten, bevor man aktiv wird. Viele warten darauf, dass alle Details und Durchführungsbestimmungen vorliegen und beteiligte Behörden benannt sind, bevor sie beginnen, ihre KI-Governance-Strategien zu entwickeln.

Ich bin jedoch der Meinung, dass dies ein falscher Ansatz ist. Eine proaktive Herangehensweise an KI-Governance bietet nämlich zahlreiche Vorteile, die über die bloße Einhaltung von Gesetzen hinausgehen. Durch die Implementierung von KI-Governance können Behörden sicherstellen, dass ihre KI-Systeme transparent, erklärbar und fair sind. Dies kann dazu beitragen, das Vertrauen der Bürger in die Verwaltung zu stärken und die Effizienz von Verwaltungsprozessen zu verbessern — diese Ziele sollte jede Behörde haben, auch ohne schon qua Gesetz dazu verpflichtet zu sein.

Darüber hinaus kann eine frühzeitige Auseinandersetzung mit KI-Governance dazu beitragen, potenzielle Risiken und Herausforderungen zu identifizieren und zu minimieren. Indem man sich bereits jetzt mit diesen Fragen auseinandersetzt, kann man sich besser auf die Zukunft vorbereiten und sicherstellen, dass die eigenen KI-Systeme den Anforderungen der Zukunft gerecht werden. Das Aufbereiten von verpflichtender Dokumentation im für die KI-Verordnung passenden Format und das Versenden an die demnächst einmal benannte Behörde lassen sich später noch finalisieren — nichts spricht allerdings dagegen und vieles vielmehr dafür, schon jetzt grundlegende Aktivitäten anzugehen wie die Formulierung einer KI-Strategie und die Inventarisierung der eigenen KI-Anwendungsfälle.

VdZ: Sie betonen das Prinzip der Wahlfreiheit: eigene Modelle, Open Source, flexible Betriebsformen. Warum ist diese Offenheit so wichtig für den öffentlichen Sektor?

Dr. Precht: Der öffentliche Sektor ist darauf angewiesen, dass KI-Systeme auch unter schwierigen Bedingungen wie Cyberangriffen, technischen Ausfällen oder geopolitischen Krisen zuverlässig und sicher funktionieren. Dafür bedarf es einer widerstandsfähigen Infrastruktur, die gewährleistet, dass KI-Systeme unter vollständiger Kontrolle stehen, in ihren Entscheidungswegen transparent bleiben und mit höchsten Sicherheitsstandards betrieben werden. Grundlegend hierfür sind die Kernanforderungen Offenheit und Flexibilität, Datensouveränität sowie durchgehende Governance und Datenschutz.

Flexible Betriebsformen spielen dabei eine Schlüsselrolle. Sie ermöglichen den Betrieb von KI-Anwendungen sowohl in der Cloud als auch On-Premises oder in hybriden Umgebungen. Dies bietet die notwendige Anpassungsfähigkeit an Sicherheits- und Compliance-Anforderungen und steigert die Ausfallsicherheit. Containerplattformen wie OpenShift sind in diesem Zusammenhang besonders wichtig, weil sie den nahtlosen und skalierbaren Betrieb von KI-Anwendungen über verschiedene Umgebungen hinweg ermöglichen.

Offene, integrierte KI-Plattformen sichern staatlichen Akteuren technologische Unabhängigkeit und erlauben die freie Wahl geeigneter KI-Modelle – vom globalen Anbieter bis zum lokal betriebenen Modell, das auf eigene Daten abgestimmt werden kann. Open Source, also Software mit offen zugänglichem Quellcode, schafft Transparenz und reduziert Abhängigkeiten. Kommerzielle Daten- und KI Plattformen wie watsonx, für die eine Open-Source-Integration ein elementarer Bestandteil ist, vereinen diese Vorteile mit der nötigen Skalierbarkeit und professionellem Support für den Praxiseinsatz.

VdZ: Wenn Sie den öffentlichen Sektor heute beraten müssten: Welche drei konkreten Schritte sollten Behörden jetzt gehen, um KI sicher, wirksam und rechtssicher zu etablieren – ohne von Hype oder Unsicherheit ausgebremst zu werden?

Dr. Precht: Für eine sichere und wirksame Etablierung von KI in öffentlichen Verwaltungen führt der Weg über drei entscheidende Etappen: Der erste Schritt muss ein gemeinsamer Analyseprozess sein. Behörden sollten mit ihren Mitarbeitenden konkret ermitteln, welche Prozesse Optimierungspotenzial bieten und welche Schmerzpunkte durch KI-Unterstützung beseitigt werden können. Wie das Beispiel des Jugendamts Augsburg zeigt, können richtig identifizierte Anwendungsfälle Bearbeitungszeiten von einer Stunde auf wenige Minuten reduzieren.

Im zweiten Schritt gilt es, eine zukunftssichere technologische Grundlage für KI-Anwendungen zu schaffen. Fragmentierte Insellösungen verursachen langfristig Integrationsprobleme. Im Gegensatz dazu, bietet eine offene und flexible KI-Plattform, analog zu einem Werkzeugkasten, die Möglichkeit fortlaufend beliebige KI-Anwendungen umzusetzen und Open-Source oder Drittanbieter-Lösungen zu integrieren. Verfügen Behörden nur über wenige KI-Experten, empfiehlt sich eine Plattform, die den Einsatz von KI-Lösungen auch ohne Programmieraufwand ermöglicht.

Das Implementieren durchgängiger Governance über den gesamten KI-Lebenszyklus ist dabei entscheidend, um regulatorische Vorgaben einzuhalten, Systeme laufend zu überwachen und Verzerrungen frühzeitig zu erkennen.

Der dritte Aspekt betrifft die strategische Infrastrukturentscheidung. Behörden sollten sorgfältig abwägen, wie sie ihre KI-Lösungen betreiben wollen. Eine containerbasierte Plattform bietet hier die nötige Flexibilität, um Betriebsmodelle später anzupassen, ohne sich an eine bestimmte Infrastruktur oder einen Anbieter zu binden. So bleibt die Souveränität über sensible Daten gewahrt, während gleichzeitig schrittweise Pilotprojekte mit messbarem Mehrwert umgesetzt werden können. Dieser dreistufige Ansatz ermöglicht es Behörden, die Vorteile von KI für eine gesteigerte Handlungsfähigkeit zu nutzen, ohne sich vom Technologie-Hype blenden zu lassen oder durch übertriebene Sicherheitsbedenken ausgebremst zu werden.